Deepfake AI từng là một khái niệm xa vời — chỉ xuất hiện trong các bộ phim khoa học viễn tưởng. Nhưng năm 2025, công nghệ này không chỉ trở thành hiện thực, mà còn đang biến đổi cách chúng ta tạo nội dung, giao tiếp và thậm chí là… tin tưởng.

Từ việc “hồi sinh” người nổi tiếng trên màn ảnh đến những đoạn video giả mạo lãnh đạo chính trị lan truyền chóng mặt, deepfake đang vẽ lại ranh giới giữa sáng tạo nghệ thuật và lạm dụng công nghệ. Vậy đâu là giới hạn? Làm sao để tận dụng được tiềm năng mà vẫn kiểm soát được rủi ro?

Deepfake AI: Sáng tạo vô hạn hay hiểm họa ngầm?

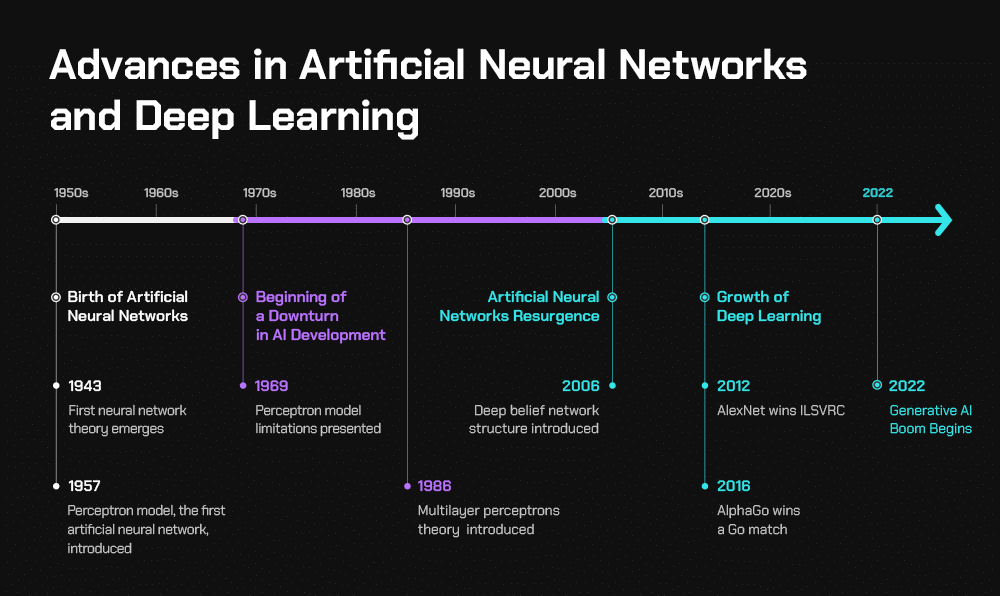

Deepfake là sự kết hợp của “deep learning” và “fake” – ám chỉ việc sử dụng mạng nơ-ron sâu để tạo ra nội dung giả một cách siêu thực. Nhờ tiến bộ của mô hình GANs và diffusion models, những video hoặc âm thanh do AI tạo ra giờ đây có thể mô phỏng khuôn mặt, giọng nói, chuyển động với độ chính xác đến từng chi tiết nhỏ.

“Vấn đề không phải công nghệ có thể làm gì, mà là chúng ta đang dùng nó để làm gì.” — Yuval Harari, Diễn giả WEF 2024

1. Khi Deepfake mở rộng cánh cửa sáng tạo

Không thể phủ nhận rằng deepfake đã mở ra hàng loạt ứng dụng tích cực. Đặc biệt là trong các ngành:

- Điện ảnh và truyền hình: Các đạo diễn như Martin Scorsese sử dụng deepfake để “trẻ hóa” diễn viên như Robert De Niro trong The Irishman.

- Game & Metaverse: Nhân vật ảo tương tác theo thời gian thực với khuôn mặt người thật được điều khiển bằng AI.

- Marketing cá nhân hóa: Doanh nghiệp tạo avatar ảo cho khách hàng tiềm năng để tăng mức độ tương tác.

Trong giáo dục, deepfake còn giúp mô phỏng các tình huống đào tạo phức tạp. Ví dụ: trường Y Harvard đang áp dụng công nghệ này để tạo bệnh nhân ảo với biểu cảm thực, giúp sinh viên y học phản ứng linh hoạt hơn.

Tác động xã hội của deepfake tích cực hơn ta nghĩ:

- Mô phỏng lịch sử bằng cách “gọi hồn” các nhân vật như Hồ Chí Minh, Gandhi để học sinh trải nghiệm thực tế.

- Người bị mất tiếng có thể “nói” trở lại qua AI voice clone.

- Người khiếm thị có thể “thấy” biểu cảm qua avatar cảm xúc AI.

Những tiến bộ này là lý do vì sao nhiều tổ chức như TRANBAO.DIGITAL đang hỗ trợ các giải pháp AI sáng tạo gắn với tiêu chuẩn đạo đức công nghệ.

2. Nhưng lằn ranh mong manh dẫn tới lạm dụng

Vấn đề không nằm ở deepfake – mà ở cách con người khai thác nó. Và những dấu hiệu lạm dụng đang ngày càng rõ nét:

Lừa đảo tài chính & giả mạo danh tính

Đã có hàng chục vụ CEO “ảo” gọi video để ra lệnh chuyển khoản. Các hacker dùng giọng nói AI để giả làm thân nhân nhờ cứu giúp, hoặc giả làm giảng viên yêu cầu truy cập tài liệu mật.

Theo nghiên cứu của McAfee (2025): 77% người lao động không phân biệt được deepfake voice qua điện thoại trong điều kiện bình thường.

Deepfake khiêu dâm và tấn công giới

“Deepnude”, “Uncensor AI” là công cụ tạo ảnh khỏa thân giả từ ảnh thật. Không cần kiến thức lập trình, bất kỳ ai cũng có thể sử dụng để tạo ảnh nạn nhân — đặc biệt là phụ nữ và trẻ em gái — rồi dùng để tống tiền, làm nhục hoặc tung lên mạng.

Theo EDRi (2025), 96% nội dung deepfake khiêu dâm là phụ nữ. Một phần ba nạn nhân chưa từng biết họ bị đưa vào nội dung giả mạo cho đến khi bị phát tán công khai.

Suy giảm lòng tin vào thông tin số

Tin giả video đang trở thành một phần trong chiến tranh thông tin. Video tổng thống phát ngôn sai, lãnh đạo doanh nghiệp “nói dối”, phóng sự giả mạo… tất cả đều khiến người xem bối rối, nghi ngờ mọi thứ họ thấy trên Internet.

Thử tưởng tượng khi camera an ninh cũng có thể bị deepfake — thì liệu bằng chứng pháp lý, tin tức truyền hình, hay livestream cá nhân còn đáng tin cậy không?

Sự nguy hiểm của deepfake không nằm ở khả năng tạo ra hình ảnh giả, mà ở việc con người sử dụng chúng để gây tổn hại — cả về danh tiếng lẫn lòng tin xã hội.

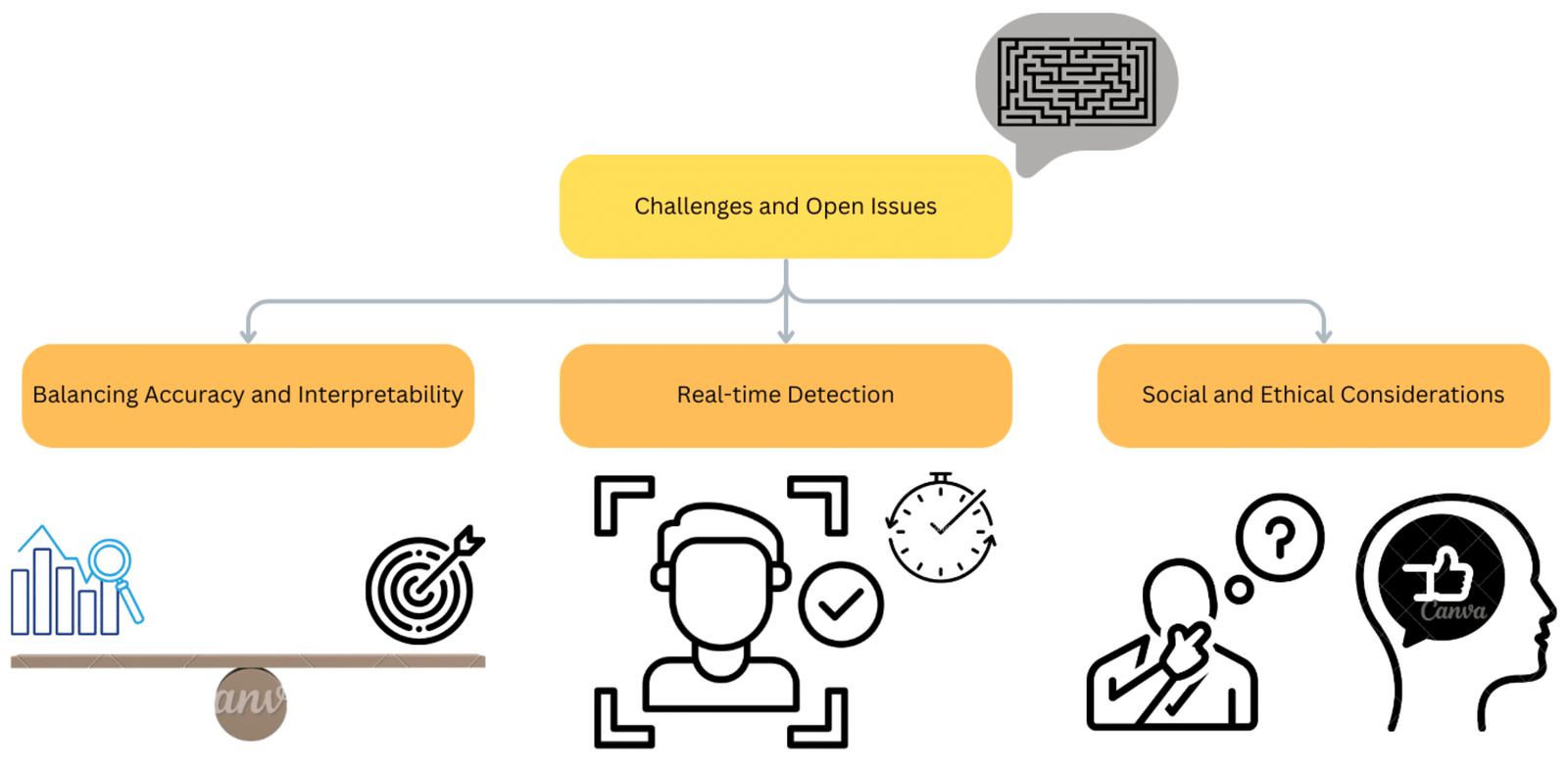

Vậy đâu là tiêu chí phân biệt giữa sáng tạo hợp pháp và hành vi vi phạm đạo đức hoặc pháp luật? Các chuyên gia AI và nhà lập pháp quốc tế đồng thuận về 4 yếu tố sau:

- Sự đồng thuận (consent): Mọi nội dung sử dụng hình ảnh, giọng nói, danh tính cần sự đồng ý rõ ràng của người bị ảnh hưởng.

- Mục đích sử dụng: Nếu deepfake dùng để gây hiểu nhầm, vu khống, hoặc thao túng – đó là lạm dụng.

- Minh bạch: Nội dung do AI tạo cần được gắn nhãn, watermark, hoặc metadata để dễ nhận diện.

- Giảm thiểu tổn hại: Nền tảng cần phát hiện, cảnh báo và gỡ bỏ nhanh chóng những nội dung nguy hiểm.

Ví dụ, một video deepfake có thể hợp pháp nếu là parody có gắn nhãn rõ, nhưng sẽ là bất hợp pháp nếu dùng để thao túng cử tri trong kỳ bầu cử mà không thông báo.

Luật pháp và quy định đang theo kịp công nghệ?

Vào giữa năm 2025, nhiều khung pháp lý mới đã bắt đầu có hiệu lực nhằm kiểm soát deepfake AI. Một số quy định quan trọng bao gồm:

1. Đạo luật AI của Liên minh châu Âu (EU AI Act)

- Yêu cầu tất cả nội dung do AI tạo ra phải được dán nhãn rõ ràng.

- Phạt nặng các tổ chức phát hành deepfake gây hiểu nhầm hoặc làm hại người khác.

- Buộc các công ty AI phải công khai nguồn dữ liệu huấn luyện (data provenance).

Theo AI Act, việc không dán nhãn nội dung deepfake có thể dẫn đến khoản phạt lên đến 30 triệu euro.

2. Hoa Kỳ và các bang đi đầu trong lập pháp

- California, Tennessee: Cấm phát tán deepfake trong quảng cáo chính trị 60 ngày trước bầu cử.

- New York: Phạt hình sự khi tạo deepfake khiêu dâm không đồng thuận.

- Minnesota: Bắt buộc các nền tảng AI phải cho phép người dùng khiếu nại nội dung deepfake.

3. Nền tảng mạng xã hội chủ động hơn

Các ông lớn công nghệ như Meta, TikTok, YouTube đã cập nhật chính sách:

- Gắn nhãn “AI-generated” ở nội dung deepfake.

- Phát triển hệ thống phát hiện tự động sử dụng watermark + AI nhận dạng.

- Cho phép người bị ảnh hưởng báo cáo nội dung và yêu cầu gỡ bỏ.

Đây là một bước tiến giúp hạn chế lạm dụng. Tuy nhiên, như TRANBAO.DIGITAL từng phân tích, tốc độ phát triển công nghệ luôn đi nhanh hơn luật. Điều quan trọng là **nâng cao nhận thức và chủ động phòng ngừa từ người dùng**.

Hướng đến một tương lai số an toàn và sáng tạo

Công nghệ không bao giờ là “xấu” – chỉ có con người mới định nghĩa cách sử dụng nó. Deepfake có thể là đòn bẩy cho nghệ thuật, truyền thông và giáo dục, nhưng cũng có thể trở thành công cụ hủy hoại nếu không kiểm soát được.

Chúng ta cần một tư duy “song hành”: khai thác công nghệ, đồng thời hiểu rõ giới hạn và trách nhiệm đạo đức.

“Deepfake sẽ không biến mất. Nhưng chúng ta có thể chọn cách sống cùng nó một cách văn minh.” — Trích từ hội nghị AI Châu Á 2025

Câu hỏi thường gặp về Deepfake AI

1. Làm sao để biết video có phải deepfake không?

Bạn có thể sử dụng các công cụ như Deepware Scanner hoặc TrueMedia để kiểm tra watermark, metadata và dấu hiệu bất thường.

2. Tôi có thể kiện nếu bị lạm dụng hình ảnh trong deepfake?

Hoàn toàn có thể. Nhiều quốc gia, bao gồm Việt Nam, đã có khung pháp lý xử lý việc tạo và phát tán nội dung giả mạo không đồng thuận.

3. Deepfake có thể dùng trong giáo dục không?

Có. Nhiều trường đại học quốc tế đang dùng deepfake để mô phỏng nhân vật lịch sử, bác sĩ ảo, hoặc các tình huống thực tế để nâng cao trải nghiệm học tập.

4. Deepfake voice có hợp pháp không?

Nếu dùng cho mục đích cá nhân hoặc sáng tạo hợp pháp (có dán nhãn rõ ràng), thì không vi phạm. Tuy nhiên, nếu dùng để giả mạo người khác, thao túng, hoặc gây thiệt hại thì có thể bị xử lý hình sự.

5. Làm sao để bảo vệ bản thân khỏi deepfake?

- Không chia sẻ ảnh chân dung công khai quá mức.

- Sử dụng các công cụ chặn tải hình như TRANBAO.DIGITAL đề xuất.

- Luôn kiểm tra thông tin trước khi tin vào video/audio lan truyền.

Kết luận

Deepfake AI là hiện thân của hai mặt tiến bộ công nghệ: một bên là sáng tạo không giới hạn, bên còn lại là những hệ lụy nghiêm trọng về đạo đức và pháp luật. Điều quyết định nằm ở cách chúng ta sử dụng và phản ứng với công nghệ đó.

Hãy là người dùng thông minh: kiểm chứng nội dung, nâng cao nhận thức, và không để sự tiện lợi của AI làm mờ đi ranh giới đạo đức.

Đôi khi, điều cần thiết không phải là học cách “phân biệt thật giả”, mà là học cách đặt câu hỏi: ai đang kiểm soát câu chuyện mà bạn đang xem?

188betlogin is a really solid platform for sports betting! Easy to navigate, loads of markets. Highly recommended for fellow punters. 188betlogin

Downloaded the b29apk on my phone and I must say now I have access to all the games on the go! A must download for those on the move all the time! b29apk

Locked out of my 91club account! Anyone know the easiest way to reset the login password? Feeling kinda frustrated, could really use some guidance. Reset your password at 91clubloginpassword.

Alright, folks! So I tried 91rummybet the other day. Rummy’s my jam, and this site does the trick. Payouts were quick, which is a huge plus. A few more tournaments would be cool, but I’m definitely sticking around. Give it a shot: 91rummybet

Logged into bg678logingame last night and played for hours! The game is actually quite challenging and keeps you hooked. The login process is simple and fast too, no annoying delays. Give it a whirl: bg678logingame